Règlement (UE) 2024/1689 du Parlement européen et du Conseil du 13 juin 2024 établissant des règles harmonisées concernant l’intelligence artificielle et modifiant les règlements (CE) n° 300/2008, (UE) n° 167/2013, (UE) n° 168/2013, (UE) 2018/858, (UE) 2018/1139 et (UE) 2019/2144 et les directives 2014/90/UE, (UE) 2016/797 et (UE) 2020/1828 (règlement sur l’intelligence artificielle)

JOUE Série L du 12 juillet 2024

Ce texte (dénommé « règlement sur l’intelligence artificielle » ou « IA Act ») vient encadrer le développement, la mise sur le marché, la mise en service et l’utilisation de systèmes d’intelligence artificielle dans l’Union européenne.

Il s’applique aux personnes suivantes :

– fournisseurs établis ou situés dans l’Union ou dans un pays tiers qui mettent sur le marché ou en service des systèmes d’IA ou qui mettent sur le marché des modèles d’IA à usage général dans l’Union ;

– déployeurs de systèmes d’IA qui ont leur lieu d’établissement ou sont situés dans l’Union ;

– fournisseurs et déployeurs de systèmes d’IA qui ont leur lieu d’établissement ou sont situés dans un pays tiers, lorsque les sorties produites par le système d’IA sont utilisées dans l’Union ;

– importateurs et distributeurs de systèmes d’IA ;

– fabricants de produits qui mettent sur le marché ou en service un système d’IA en même temps que leur produit et sous leur propre nom ou leur propre marque ;

– mandataires des fournisseurs qui ne sont pas établis dans l’Union ;

– de manière générale, aux personnes concernées situées dans l’Union.

Il précise l’articulation de ses dispositions avec différentes réglementations. En particulier, il prévoit que le texte n’a pas d’incidence sur les textes de l’Union en matière de protection des données à caractère personnel, de respect de la vie privée et de confidentialité des communications, et que ces textes s’appliquent bien aux données à caractère personnel traitées dans le cadre de l’IA.

Il s’appuie en premier lieu sur une classification des systèmes d’IA en fonction des risques que ceux-ci présentent. Il en découle l’interdiction de certaines pratiques en matière d’IA (telles que les systèmes ayant recours à l’IA subliminale, manipulatrice, trompeuse ou discriminante).

En outre, le texte établit des exigences spécifiques et renforcées pour les systèmes d’IA classifiés à haut risque selon les critères de l’article 6 et de l’annexe III du texte. Il s’agit notamment de certains systèmes d’IA répertoriés dans les domaines de la biométrie, de l’éducation et de la formation professionnelle, de l’emploi, de l’accès aux services publics, de la répression et de la justice.

Les fournisseurs et déployeurs de tels systèmes doivent notamment :

– concevoir leur système d’IA pour que celui-ci enregistre automatiquement les événements pertinents pour l’identification des risques au niveau national et pour atteindre les niveaux appropriés de précision, de robustesse et de cybersécurité ;

– assurer la gouvernance des données ;

– mettre en œuvre un système de gestion des risques et un système de gestion de la qualité ;

– établir une documentation technique pour démontrer la conformité, fournir aux autorités les informations nécessaires à l’évaluation de cette conformité et fournir des instructions d’utilisation aux utilisateurs en aval pour leur permettre de se conformer à la réglementation.

Le texte fixe également des règles harmonisées en matière de transparence applicables :

– aux systèmes d’IA destinés à interagir avec des personnes ;

– aux systèmes de reconnaissance des émotions et de catégorisation biométrique ;

– aux systèmes d’IA générative utilisés pour générer ou manipuler des images ou des contenus audio ou vidéo.

Il établit des prescriptions pour la mise sur le marché de modèles d’IA à usage général, en particulier des règles de classification en tant que modèles présentant un risque systémique, pour lesquels des obligations renforcées sont fixées (notamment la notification de ces systèmes à la Commission, l’atténuation des risques et la garantie d’un niveau élevé de protection en matière de cybersécurité).

Enfin, il organise la mise en œuvre de cette réglementation qui, outre les sanctions encourues en cas de non-respect, s’appuie notamment :

– au niveau européen, sur la création d’un Bureau européen de l’IA et d’un Comité IA ainsi que sur l’adoption de futurs actes délégués d’exécution de la Commission, de codes de conduite et de lignes directrices ;

– au niveau national, sur la désignation d’autorités notifiantes et d’organismes notifiés ainsi que sur la mise en place de « bacs à sable réglementaires de l’IA » permettant d’expérimenter le développement et la mise à l’essai de systèmes d’IA innovants dans un cadre contrôlé.

Ce texte s’applique :

– à compter du 2 février 2025 pour les chapitres Ier (Dispositions générales) et II (Pratiques interdites en matière d’IA) ;

– à compter du 2 août 2025 pour le chapitre III, section 4 (Autorités notifiantes et organismes notifiés), le chapitre V (Modèles d’IA à usage général), le chapitre VII (Gouvernance), le chapitre XII (Sanctions) et l’article 78 (Confidentialité) ;

– à compter du 2 août 2027 pour la définition des systèmes d’IA à haut risque figurant à l’article 6 §1 ;

– à compter du 2 août 2026 pour les autres dispositions.

Pour les systèmes existants, les modalités d’application suivantes sont organisées :

– les systèmes d’IA qui constituent des composants de systèmes d’information à grande échelle établis par les actes juridiques énumérés à l’annexe X du texte et mis sur le marché ou mis en service avant le 2 août 2027 doivent être mis en conformité avec le texte pour le 31 décembre 2030 ;

– le texte s’applique aux opérateurs de systèmes d’IA à haut risque mis sur le marché ou mis en service avant le 2 août 2026 uniquement si, à compter de cette date, ces systèmes subissent d’importantes modifications de leurs conceptions ; en tout état de cause, les fournisseurs et les déployeurs de systèmes d’IA à haut risque destinés à être utilisés par des autorités publiques doivent prendre les mesures nécessaires pour se conformer aux exigences et obligations du texte pour le 2 août 2030 ;

– les fournisseurs de modèles d’IA à usage général mis sur le marché avant le 2 août 2025 doivent prendre les mesures nécessaires pour se conformer au texte au plus tard le 2 août 2027.

Les plus lus…

Les directives européennes NIS2 et REC doivent prochainement être transposées dans le droit français. Fabricants d’équipements de sécurité physique,…

La directive (UE) 2025/794 du Parlement européen et du Conseil du 14 avril 2025 est venue modifier les dates…

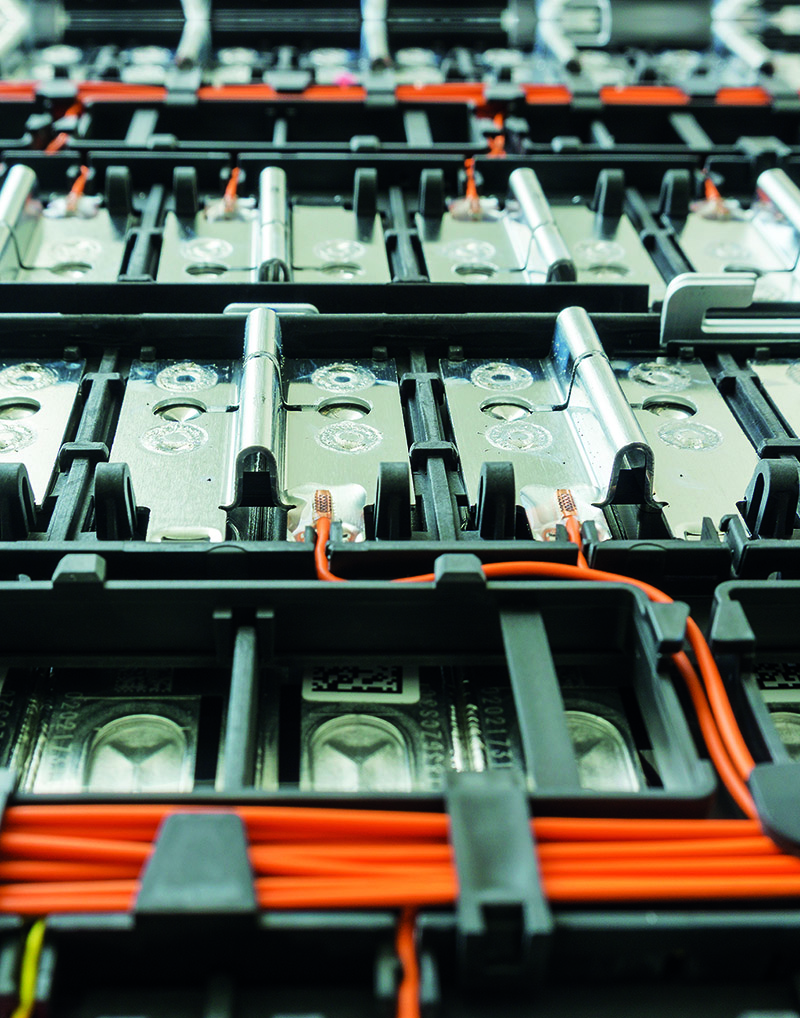

Deux arrêtés en date du 27 mars 2025 concernent les deux filières à responsabilité élargie du producteur (REP) « batteries…

Toute l’équipe de Face au Risque est ravie d’annoncer qu’elle a remporté la Victoire du design graphique pour son…

Le Conseil national des activités privées de sécurité (Cnaps) a confirmé, le 10 avril 2025, à l’issue d’un recours gracieux,…

Dans un nouveau rapport, Allianz Commercial rappelle que les troubles à l’ordre public constituent le principal risque pour plus…

À lire également